1. 场景

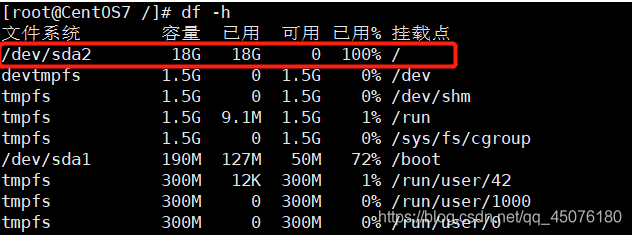

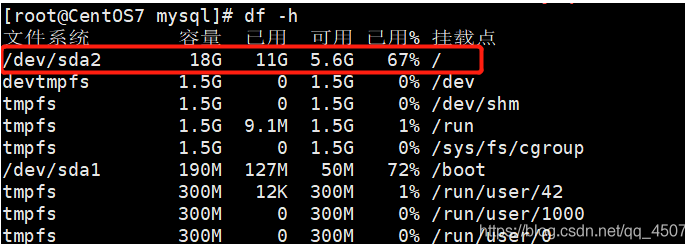

在linux环境下安装mysql时,解压时出现解压失败,原因时空间不足!通过 df -h 命令查看磁盘空间,发现**/dev/sda2** 的空间已经被占用了100%,怪不得解压失败。

2. 解决方案

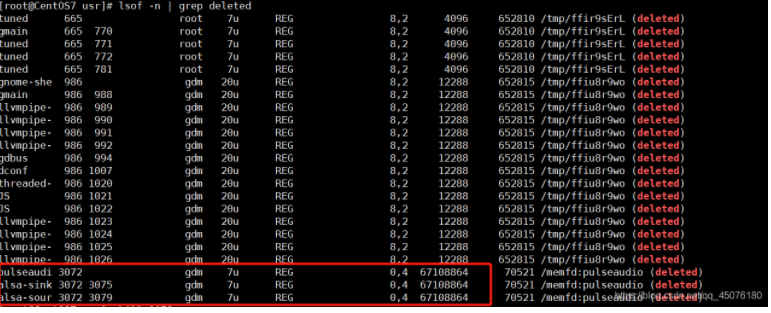

首先使用 lsof -n |grep deleted 命令查看一下已删除、但空间却没有释放的进程

发现最后三个进程,占用空间较大,有180M左右,但远不到18g,所以这里不是导致内存占用100%的主要原因,可以先排除这里。如果这里空间占用超大,可以使用 kill -9 杀死对应进程即可。

排除了上面的原因,我们继续查找

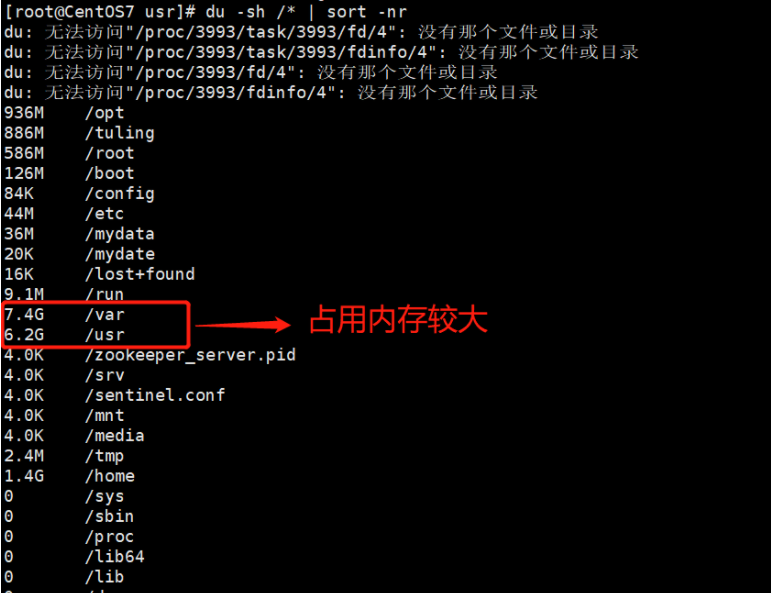

使用 du -sh /* | sort -nr 命令查找 / 目录下所有文件和目录的大小的排序结果。 查找结果如下

我们发现 /var 、/usr目录占用内存较大

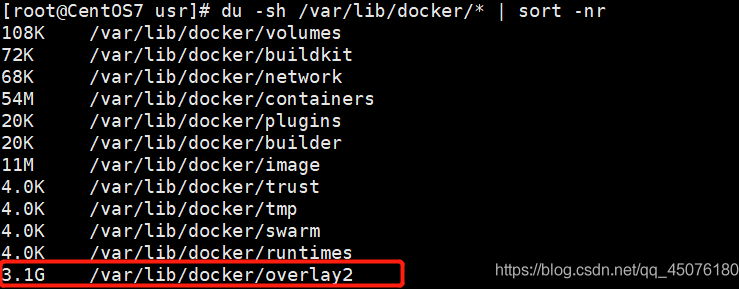

继续使用 du -sh /var/* | sort -nr 、 du -sh /usr/* | sort -nr 命令进一步跟踪大文件,

发现overlay2这个文件过大,也确定这个文件无用后 ,使用rm -rf 执行删除后,再次使用 df -h 查看磁盘空间

经过上面两个大文件的删除,发现磁盘空间已经降下来了,再次解压mysql,解压成功!

清理docker日志

查看所有容器日志大小和清理所有容器日志命令:

ls -lh $(find /var/lib/docker/containers/ -name *-json.log) truncate -s 0 /var/lib/docker/containers/*/*-json.log

2.2 清理Docker容器日志(治标)

如果docker容器正在运行,那么使用rm -rf方式删除日志后,通过df -h会发现磁盘空间并没有释放。原因是在Linux或者Unix系统中,通过rm -rf或者文件管理器删除文件,将会从文件系统的目录结构上解除链接(unlink)。如果文件是被打开的(有一个进程正在使用),那么进程将仍然可以读取该文件,磁盘空间也一直被占用。正确姿势是cat /dev/null > *-json.log,当然你也可以通过rm -rf删除后重启docker。接下来,提供一个日志清理脚本clean_docker_log.sh,内容如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

|

#!/bin/sh echo "======== start clean docker containers logs ========"logs=$(find /var/lib/docker/containers/ -name *-json.log) for log in $logs do echo "clean logs : $log" cat /dev/null > $log doneecho "======== end clean docker containers logs ========" |

|

1

2

3

|

# chmod +x clean_docker_log.sh# ./clean_docker_log.sh |

但是,这样清理之后,随着时间的推移,容器日志会像杂草一样,卷土重来。

2.3 设置Docker容器日志大小(治本)

- 设置一个容器服务的日志大小上限

上述方法,日志文件迟早又会涨回来。要从根本上解决问题,需要限制容器服务的日志大小上限。这个通过配置容器docker-compose的max-size选项来实现

|

1

2

3

4

5

6

7

|

nginx: image: nginx:1.12.1 restart: always logging: driver: “json-file” options: max-size: “5g” |

重启nginx容器之后,其日志文件的大小就被限制在5GB,再也不用担心了。

- 全局设置

新建/etc/docker/daemon.json,若有就不用新建了。添加log-dirver和log-opts参数,样例如下:

|

1

2

3

4

5

6

7

|

# vim /etc/docker/daemon.json{ "registry-mirrors": ["http://f613ce8f.m.daocloud.io"], "log-driver":"json-file", "log-opts": {"max-size":"500m", "max-file":"3"}} |

max-size=500m,意味着一个容器日志大小上限是500M,

max-file=3,意味着一个容器有三个日志,分别是id+.json、id+1.json、id+2.json。

注意:设置的日志大小,只对新建的容器有效。