一、搭建自己的大模型助手

大型模型的出现为许多领域带来了革命性的变化,从自然语言处理到计算机视觉,甚至是医学和金融领域。 OpenRouter 为使用者提供了部分开源模型的实现,可以通过API免费使用,比如 openai的chatgpt3.5,谷歌的gemma-7b ,Mistral AI 的 mistral-7b-instruct,一定程度避免了自己去部署大模型的成本。也可以付费使用chatgpt4-vesion,claude-3-opus,gemini-pro-vision等强大的模型,通过lobe-chat无需魔法就可以使用,而且付费模型可以使用国内的信用卡。

二、搭建lobe-chat

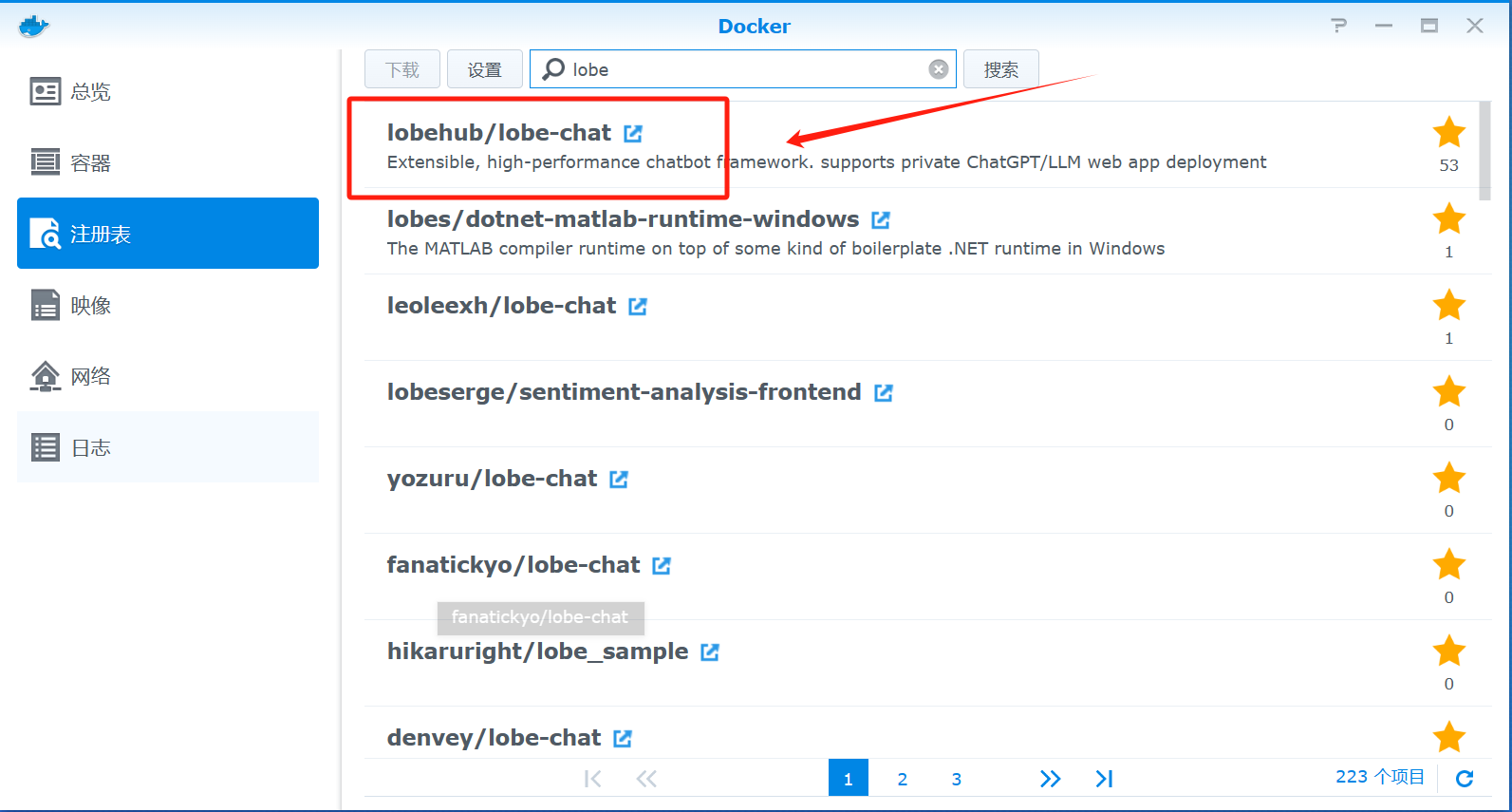

打开群晖的docker,注册表搜索lobe-chat并双击下载

创建容器

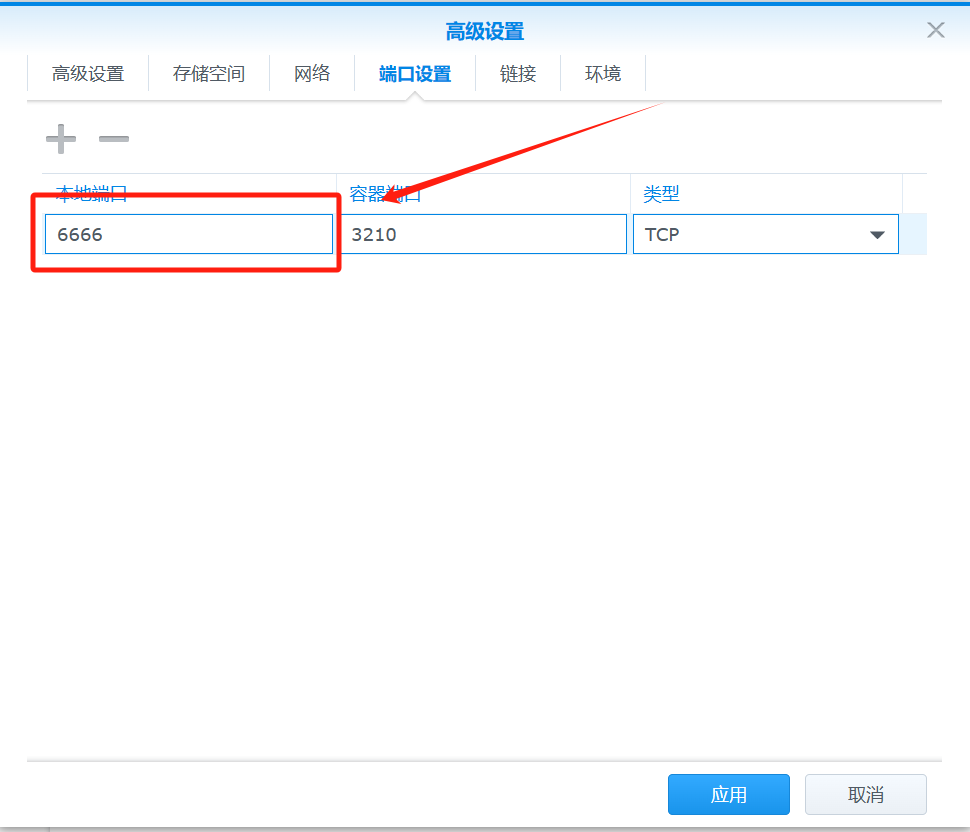

点击高级设置-端口设置,可以使用默认的端口也可以修改自己喜欢的端口,只要不跟你网络的端口冲突就行

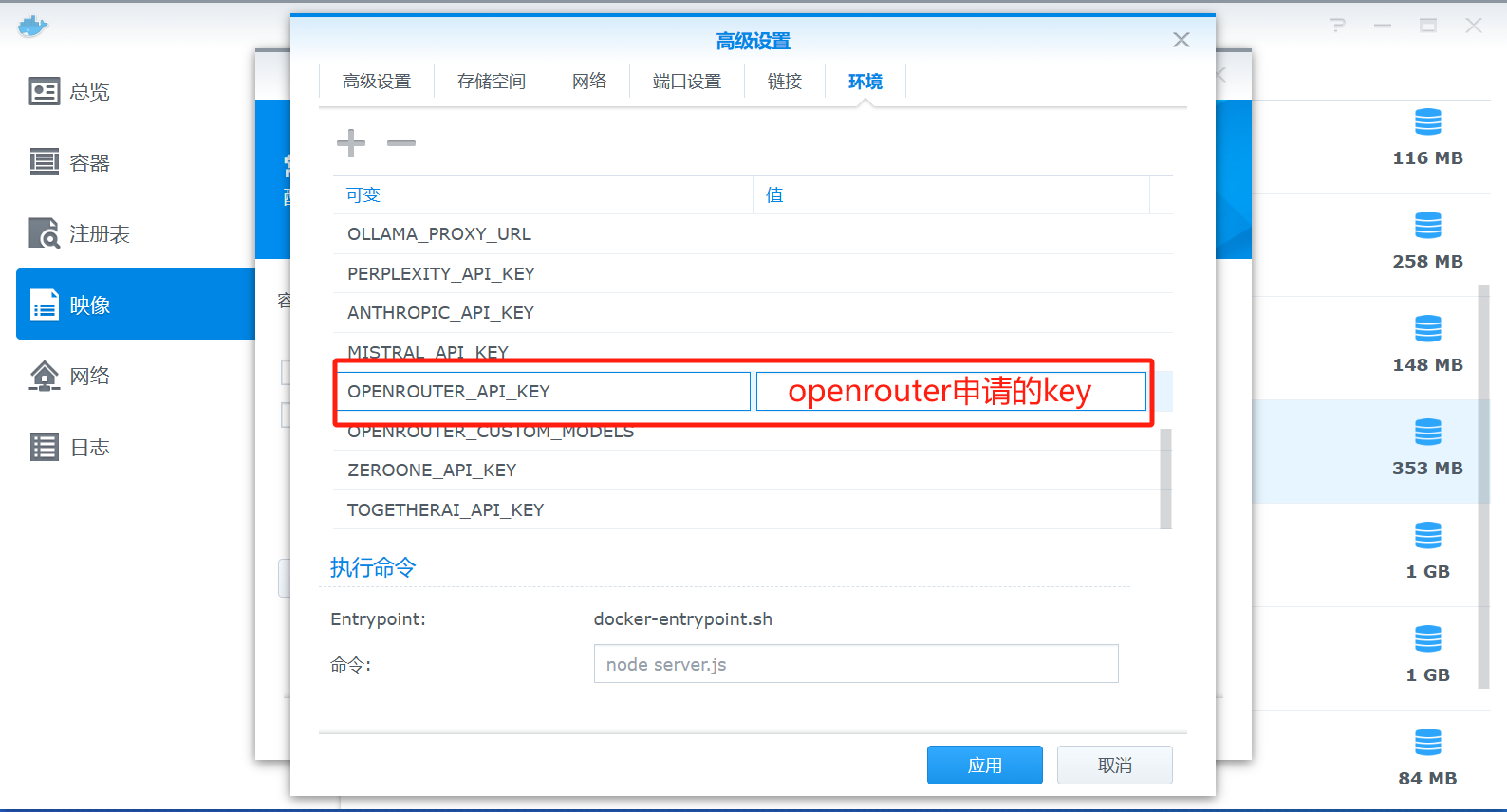

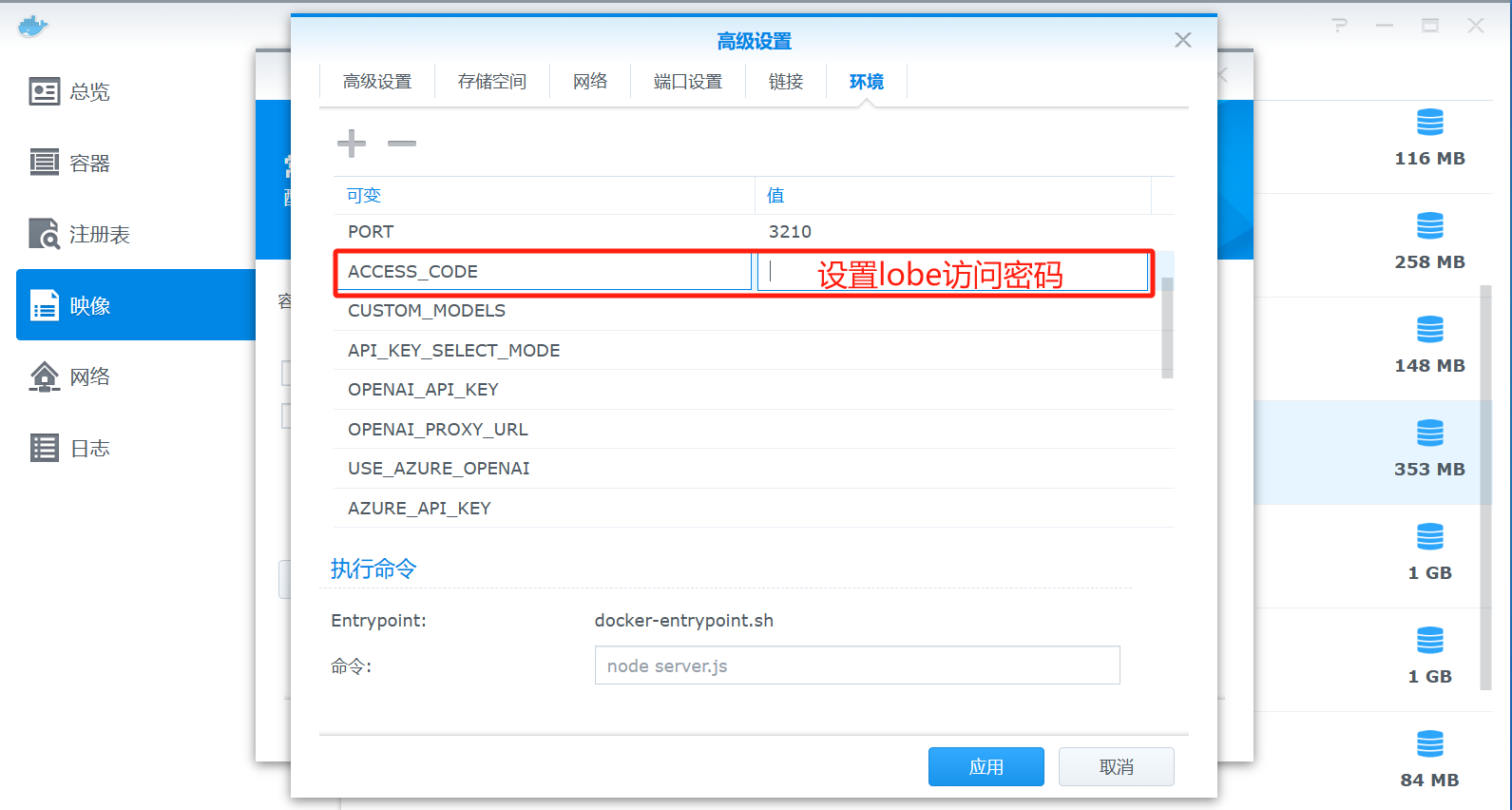

点开环境变量,填写你申请的key

设置访问密码,密码复杂一点免的被别人强破

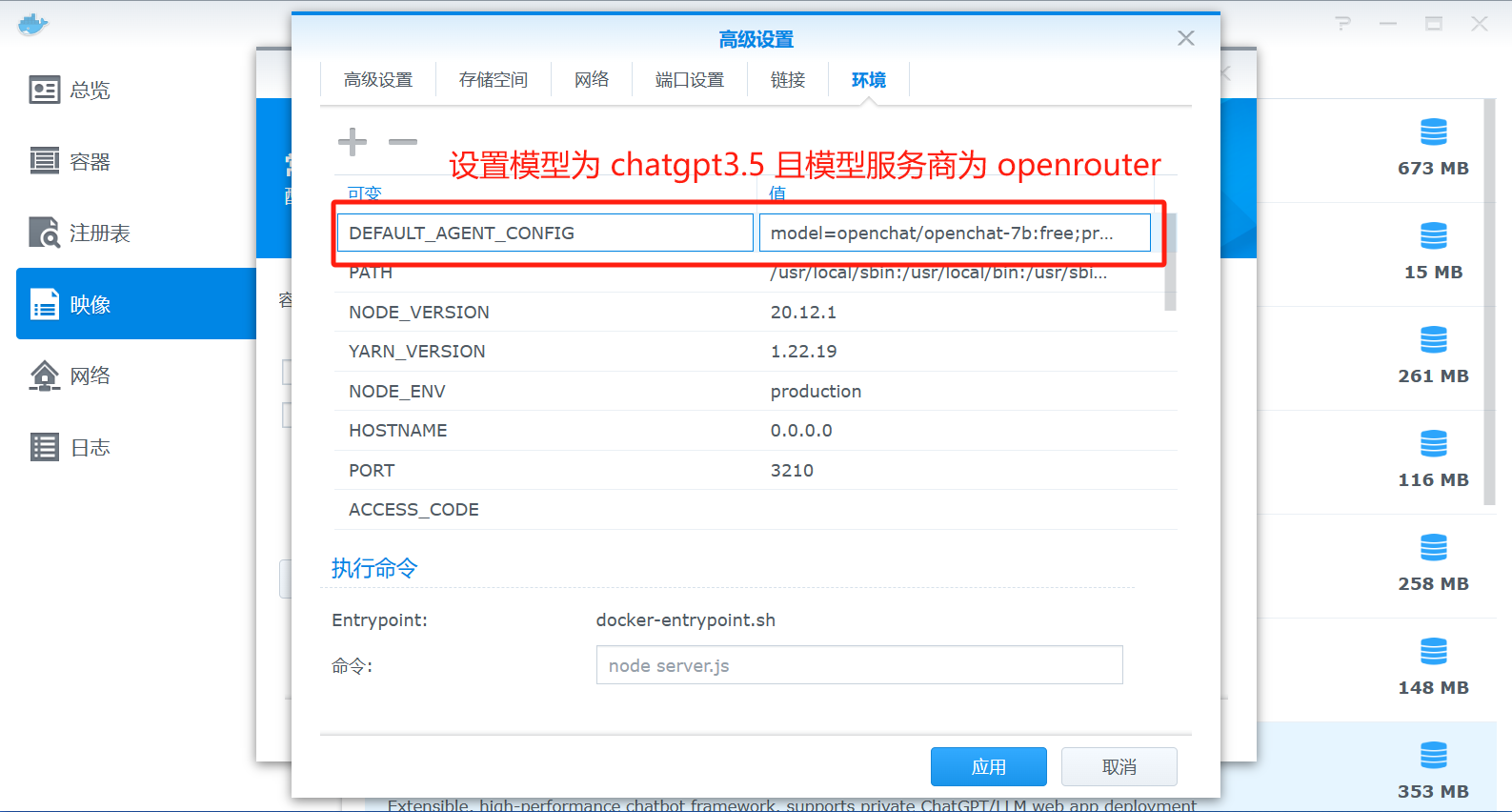

设置DEFAULT_AGENT_CONFIG变量(可选)

设置模型为 chatgpt3.5 且模型服务商为 openrouter

DEFAULT_AGENT_CONFIG 值 model=openchat/openchat-7b:free;provider=openrouter

因为lobe-chat默认模型为openai的chatgpt3.5,如果我们没有设置OpenapiKey,lobe-chat会提示没有设置key,但是我们使用的是OpenRoute为服务商,为了方便,我们设置默认OpenRoute提供的chatgpt3.5为默认模型,这样不需要复杂的设置就可以直接使用了。